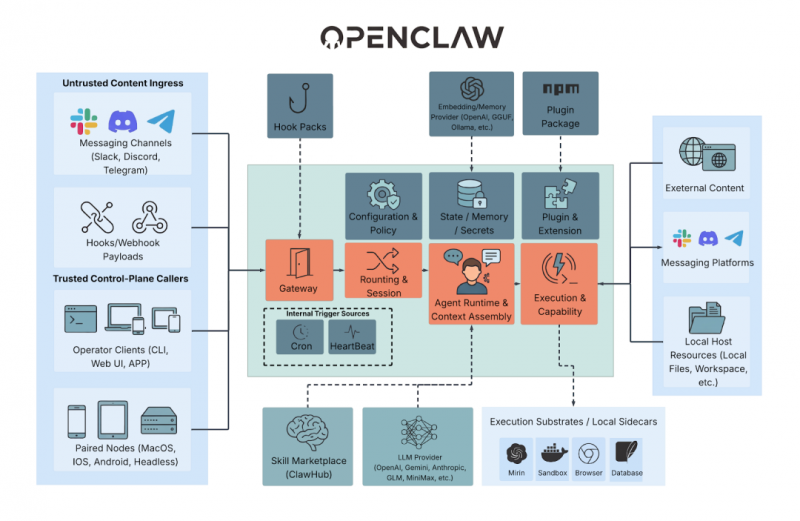

前不久,CertiK正式发布《OpenClaw安全报告》,对当前现象级AI智能体框架OpenClaw的安全状况进行全面复盘与深度解读。该报告以已公开并修复的安全事件为核心依据,清晰呈现了OpenClaw从边缘项目到规模化应用过程中的安全短板,剖析了各类风险的核心成因,并提出面向不同主体的防护方案,为AI智能体行业安全发展提供重要参考。

据悉,OpenClaw凭借强大的功能优势快速崛起,目前其GitHub星标已突破30万,成为AI驱动助手落地应用的核心载体。但快速扩张的背后,是安全体系的滞后——早期基于“本地可信环境”搭建的安全模型,已无法应对大规模部署后的复杂应用场景。

数据显示,2025年11月至2026年3月这一周期内,OpenClaw累计产生280条安全公告,披露的CVE漏洞数量超100个,直观反映出AI智能体在行业规模化进程中面临的安全挑战。

从报告披露的细节来看,OpenClaw的安全风险主要集中在三个核心层面。架构设计上,OpenClaw在控制平面存在的底层设计缺陷,其核心网关长期以“访问来源接近性”替代身份验证机制,使得攻击者可利用本地来源、URL参数等轻易获取Shell执行、文件访问及多设备控制等完整编排权限;同时,在20余个消息平台的身份绑定机制中,由于使用可变属性及缺失Webhook验证等授权机制设计问题,导致允许列表(Allowlist)被频繁绕过,相关问题已形成约60条安全公告。

执行层面,策略校验与实际执行存在偏差,攻击者仅通过参数缩写就能绕过拒绝列表,导致预设安全边界失效;而本地工作空间因缺乏统一的文件系统边界控制,各模块独立实现校验逻辑,使得路径遍历漏洞与沙箱缺口反复出现,进一步加剧本地资产泄露风险。

供应链与部署环节的风险同样突出,ClawHub插件市场已发现数百个恶意技能,同时存在仿冒安装程序、npm软件包等问题,且AI智能体技能可通过自然语言影响系统行为,难以被传统检测机制识别。此外,部署配置风险同样不容忽视。数据显示,在82个国家发现超过13.5万个暴露在网络中的实例。而提示词注入作为尚未解决的基础性难题,必须通过多层系统级防护、严格的能力控制,并将持久性存储作为关键攻击面加以保护。

针对上述风险,CertiK在报告中给出明确的防御指引:开发者需将安全融入系统设计初期,强化控制平面防护与权限管理;部署方需规范配置流程,加强监控审计与第三方扩展审核;普通用户需保持审慎,暂不赋予AI智能体核心账户访问权限。

总体而言,CertiK《OpenClaw安全报告》系统揭示了当前AI智能体框架在部署与使用中的关键安全风险,并针对开发者与使用者提出了具有可操作性的防护建议。随着AI智能体规模化应用加速,该报告为行业识别风险边界、完善安全实践提供了重要参考,有助于推动AI智能体生态在可控与可信的基础上持续发展。。

【免责声明】本内容为广告,相关素材由广告主提供,广告主对本广告内容的真实性负责。本账号发布目的在于传递更多信息,并不代表本账号赞同其观点和对其真实性负责,广告内容仅供读者参考。

责编:梁昕

来源:耒阳市融媒体中心

!/ignore-error/1&pid=56885460 )

耒阳农商银行:方寸柜台守初心

!/ignore-error/1&pid=56885340 )

耒阳少年赵乐斌勇夺全国象棋赛冠军

!/ignore-error/1&pid=56883675 )

关于对G356线(龙塘中队至东口路段)实行全封闭交通管制的通告

!/ignore-error/1&pid=56883060 )

衡阳要下大雨啦

!/ignore-error/1&pid=56862460 )

五一我在岗 | 健康服务送上门 温情守护夕阳红

!/ignore-error/1&pid=56862370 )

立夏粥香满城 “俵”出非遗温情

!/ignore-error/1&pid=56855640 )

【凡人微光】肖聪成:千年古法造纸的“守护者”与“焕新者”

!/ignore-error/1&pid=56854830 )

雨游古街正当时!耒阳南正街成雨天短途微度假网红新地标

下载APP

分享到